NVIDIA Networking

Seit April 2020 und der Akquisition von Mellanox Technologies führt NVIDIA die Mellanox Netzwerk Produkte unter dem Namen NVIDIA Networking fort. Hierzu gehören die Ethernet- sowie InfiniBand-Lösungen. Die für Sie passenden Switche, Adapter und Zubehör finden Sie auf den entsprechenden Unterseiten:

NVIDIA Networking Ethernet NVIDIA Networking InfiniBand NVIDIA Networking CumulusGPU basiertes High Performance Computing

Turbo-Wachstum mit GPU-Computing

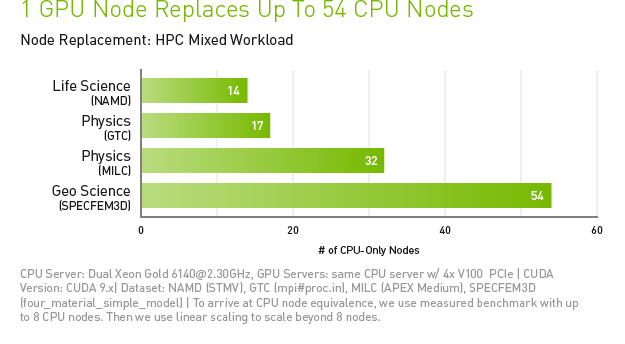

Das Mooresche Gesetz wurde mit GPU-Computing längst vom Gesetz des Turbo-Wachstums überholt. Dank einem hochspezialisierten, parallelen Grafikprozessor, speziellen Algorithmen und optimierten Anwendungs-Software, lassen sich dutzende handelsübliche CPU-Server durch einen grafikprozessorbeschleunigten Server ersetzen. Die Folge ist ein erheblich höherer Anwendungsdurchsatz sowie umfangreiche Kosteneinsparungen.

Besonders die hervorragenden Zugänglichkeit und Energieeffizienz von GPU-Computing macht es für HPC und Rechenzentren in Hinblick auf die Zukunft so interessant. Die schnellsten Supercomputer in den USA und in Europa, so wie einige geplante und extrem fortschrittliche Systeme, profitieren bereits von der Leistung der NVIDIA-Lösung. Ein Beispiel wäre hier der leistungsstärkste Supercomputer "Summit" am Oak Ridge National Laboratory USA, mit über 200 PetaFLOPS für HPC und 3 ExaOPS für KI. Summit kombiniert HPC- und KI-Computing mit Hilfe von 27.000 NVIDIA Volta-Grafikprozessoren mit Tensor-Recheneinheiten. Heute steht das NVIDIA-Grafikprozessoren beschleunigtes Computing und die damit verbundene Schnittmenge von HPC und KI im Mittelpunkt der vielversprechendsten Forschungsbereiche, in denen HPC eingesetzt wird. Dies bietet somit enormes Potenzial für den wissenschaftlichen Fortschritt und beschleunigt Innovationen in diesem Bereich.

Die Künstliche-Intelligenz (KI), als wesentlicher Bestandteil, ermöglicht es unlösbar geltende Problem anzugehen, in dem Modelle realer Bedingungen anhand von Daten aus Experimenten und Simulationen erstellt werden. Zudem lassen sich die Ergebnisse bereits in Echtzeit darstellen, während vergleichbare Simulationen früher Tage oder Monate in Anspruch nahmen.

NVIDIA Tesla V100-GPU mit Tensor-Recheneinheiten

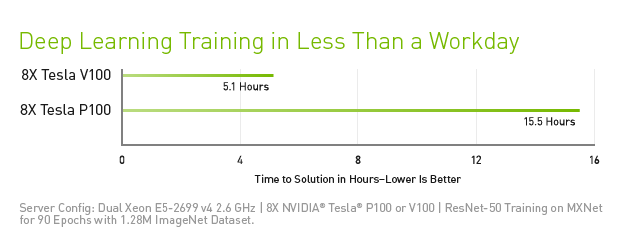

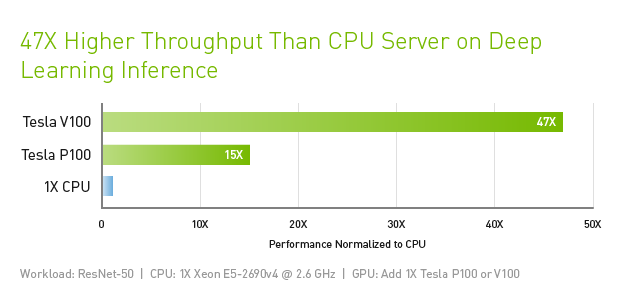

Der NVIDIA® Tesla® V100 gilt dank der Leistung seiner Volta-Architektur, als einer der fortschrittlichste Grafikprozessor für Rechenzentren. Ausgelegt auf die Konvergenz von HPC und KI, eignet er sich als Plattform für HPC-Systeme, die für wissenschaftliche Simulationen und zum Identifizieren wertvoller Informationen in Daten eingesetzt wird. Dabei kann ein einziger Server mit Tesla V100-GPUs bei herkömmlichen HPC- und bei KI-Workloads Hunderte standardmäßige reine CPU-Server ersetzen. Die resultierende Leistung kann folglich den Datenwissenschaftlern, Forschern und Ingenieuren zur Verfügung gestellt werden, um Herausforderungen zu bewerkstelligen, die bislang als unüberwindbar galten.

Die GPU steht in zwei Varianten zur verfügung, das PCle Modell ist für optimale Vielseitigkeit bei allen Workloads auf HPC ausgelegt, während die NVLink Variante für hohe Leistung bei Deep Learning sorgt. Beide Karten sind mit 16GB oder 32GB HBM2 Speicher zu haben.

Nvidia Tesla V100 GPU für PCle oder NVLink (16 oder 32GB)

Nvidia Tesla V100 GPU für PCle oder NVLink (16 oder 32GB)Technische Daten & Spezifikationen - Tesla V100

- LEISTUNG mit NVIDIA GPU Boost™

| Modell: | Tesla V100 für NVLink | Tesla V100 für PCIe |

| Doppelte Genauigkeit: | 7.8 TeraFLOPS | 7.0 TeraFLOPS |

| Einfache Genauigkeit: | 15.7 TeraFLOPS | 14.0 TeraFLOPS |

| Deep Learning: | 125 TeraFLOPS | 112 TeraFLOPS |

| NVIDIA Tensor Kerne: | 640 | 640 |

| NVIDIA CUDA™ Kerne: | 5.120 | 5.120 |

| Verbindungsbandbreite: Bidirektional | 300 GB/s | 32 GB/s |

| Stapelspeicher: CoWoS-HBM2 | 32/16 GB | 32/16 GB |

| Bandbreite: | 900 GB/s | 900 GB/s |

| System Interface: | PCIe Gen3 | NVIDIA NVLink |

| Form Factor: | PCIe FullHeight/Length | SXM2k |

| Max. Verbrauch: | 300 Watt | 250 Watt |

| ECC: | ✔ | ✔ |

| Kühlung: | Passiv | Passiv |

| Compute APIs: | CUDA, DirectCompute, OpenCL, OpenACC | |